Durante una visita a Japón en 1999, el investigador Peter Kazansky se encontró con un misterioso fenómeno físico que ahora cree que contiene la clave para el futuro del almacenamiento de datos.

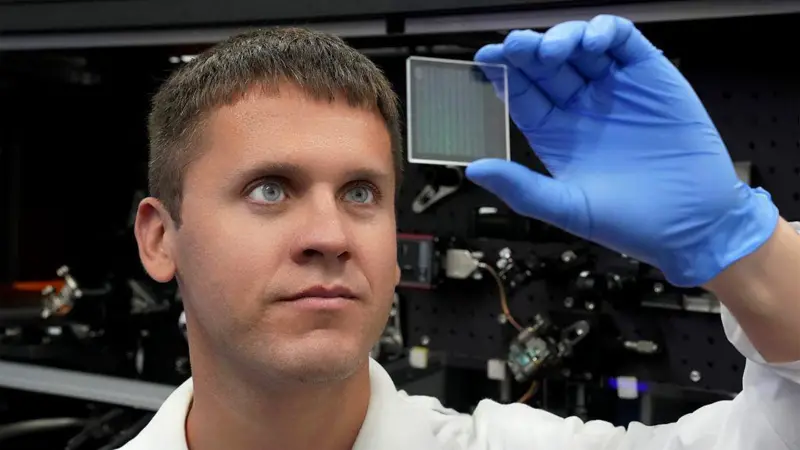

En el laboratorio de optoelectrónica de la Universidad de Kioto, los científicos experimentaban con escribir sobre vidrio utilizando láseres ultrarrápidos de femtosegundos, que emiten un pulso de luz cada cuatrillonésima de segundo.

Pero notaron algo inusual en cómo la luz viajaba a través del vidrio tratado con láser. La dispersión de Rayleigh es un efecto bien establecido que describe cómo la luz blanca rebota en partículas pequeñas en todas direcciones (lo que explica, entre otras cosas, por qué el cielo se ve azul). Pero en este caso, la luz no rebotaba como se esperaba.

“Fue difícil de explicar”, afirma Kazansky, profesor de optoelectrónica en la Universidad de Southampton (Reino Unido), quien colaboraba con los investigadores de la Universidad de Kioto. “Vimos cómo la luz se dispersaba de una manera que parecía desafiar las leyes de la física”.

La observación desconcertante acabó provocando “un auténtico momento eureka”, dice Kazansky. Los investigadores descubrieron nanostructuras ocultas dentro del vidrio de sílice, creadas por “microexplosiones” generadas por los láseres de femtosegundos.

Imagina sostener un grueso trozo de cristal a contraluz y ver cómo la luz rebota en muchas direcciones distintas. Con la técnica del láser, los investigadores de Kioto habían creado accidentalmente pequeños orificios con esa misma propiedad.

Unas mil veces más pequeños que el grosor de un cabello humano, estos “remolinos” de luz son tan diminutos que resultan imperceptibles para el ojo humano. Pero pronto quedó claro para los científicos que tenían un potencial transformador. “Esta fue la primera prueba de que podíamos usar la luz para imprimir patrones complejos dentro de materiales transparentes a una escala menor que la longitud de onda de la luz”, afirma Kazansky.

Ahora, 27 años después, espera que aquel descubrimiento pueda ayudar a resolver uno de los problemas más difíciles de nuestra era de la información: el almacenamiento masivo de datos.

Todo esto hace que la búsqueda de soluciones alternativas sea cada vez más urgente. Kazansky está adoptando un enfoque novedoso al problema. En los años posteriores a aquella primera revelación en la Universidad de Kioto, descubrió que los remolinos de diminutas perforaciones grabadas en el vidrio podían leerse de forma muy similar a los datos en las fibras ópticas.

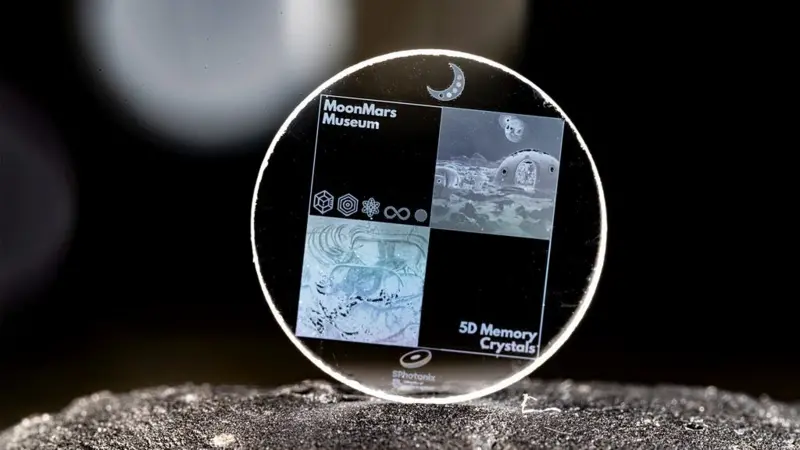

Explica que este método codifica datos en cinco dimensiones utilizando la diferencia en la orientación y la intensidad de la luz combinadas con la ubicación de distintos “vóxeles” (es decir, píxeles tridimensionales individuales con coordenadas x, y, z).

“Al aprovechar estas propiedades de la luz, podemos almacenar datos en cinco dimensiones en lugar de las tres habituales, lo cual es la clave para lograr la alta densidad necesaria para un almacenamiento ‘eterno'”, afirma Kazansky.

La información se lee mediante un microscopio óptico especializado equipado con una cámara capaz de detectar tanto la intensidad como la polarización de la luz. “Como las nanoestructuras modifican la forma en que la luz viaja a través de ellas, usamos ópticas especiales para ‘ver’ esos cambios de polarización, que luego se decodifican nuevamente en datos digitales”, explica Kazansky.

En los “cristales de memoria” de Kazansky, se necesita energía únicamente para el proceso de escritura de datos, pero no se requiere energía adicional para mantenerlos, y el proceso de lectura tampoco es intensivo en consumo.

Pueden contener una cantidad vertiginosa de información en un área muy pequeña: teóricamente, hasta 360 terabytes (TB) -cada uno equivalente a 1.000 GB- en un disco de vidrio de 5 pulgadas (12,7 cm).

Y, según afirma, pueden durar esencialmente para siempre. Están hechos de vidrio de sílice fundido, conocido por su durabilidad y estabilidad térmica. La única precaución especial es mantenerlos dentro de un contenedor resistente, ya que, al estar hechos de vidrio, siguen siendo vulnerables a romperse de la manera tradicional.

Kazansky, junto con su hijo, fundó una empresa en 2024 para comercializar su idea y recientemente completó una ronda de financiación de US$4,5 millones. Afirma que SPhotonix ya está en conversaciones con empresas tecnológicas para estrenar algunos de sus prototipos en centros de datos durante los próximos años. Por ahora, sin embargo, señala que el objetivo sigue siendo “perfeccionar la tecnología para garantizar que sea lo suficientemente robusta” para estos usos.

Actualmente, la empresa puede alcanzar una velocidad de lectura de unos 30 MB por segundo, pero espera aumentar las velocidades de lectura y escritura hasta 500 MB por segundo en los próximos tres a cinco años, según Kazansky. (En comparación, las soluciones más recientes de almacenamiento en cinta magnética ofrecen hasta 400 MB por segundo).

“Nuestra meta es que recuperar datos… sea tan fluido como usar un disco duro moderno”, afirma.

Pero no todos creen que los cristales de memoria representen el futuro inmediato del almacenamiento de datos. Según Srinivasan Keshav, profesor de informática en la Universidad de Cambridge (Reino Unido), uno de los problemas es que la tecnología no es “compatible con la infraestructura existente”, lo que crea “enormes barreras de adopción”.

Kazansky no es el único que piensa en cómo afrontar la enorme acumulación de datos del siglo XXI. Mientras él ha encontrado respuestas en granos de arena, otros han recurrido al sustrato granular de toda la vida orgánica.

Repensar la computación

Resolver el problema del almacenamiento de datos a largo plazo es solo una parte del desafío que representan los centros de datos, grandes consumidores de energía.

La sílice y el ADN son “muy atractivos desde una perspectiva de sostenibilidad”, reconoce Tania Malik, profesora adjunta en la Escuela de Computación y Ciberseguridad de la Universidad Tecnológica de Dublín (Irlanda).

“Sin embargo, es poco probable que estas tecnologías sustituyan al almacenamiento convencional para la informática cotidiana o las cargas de trabajo de IA en un futuro cercano”, advierte.

Malik señala que existen formas más prácticas de abordar, en el corto plazo, el problema del consumo energético asociado a los “datos calientes”.

“Un área importante es mejorar la eficiencia de la infraestructura, por ejemplo mediante procesadores más eficientes energéticamente y técnicas avanzadas de refrigeración, como la refrigeración líquida o la refrigeración por aire exterior”, afirma.

Al mismo tiempo, añade que hay un “reconocimiento creciente de que la eficiencia también debe abordarse a nivel del software y de las cargas de trabajo, no solo a nivel de la infraestructura”.

Malik afirma que en la informática de alto rendimiento y en la computación en la nube, el rendimiento ha sido tradicionalmente la métrica dominante, pero la eficiencia energética debe considerarse igual de importante. “Esto implica diseñar algoritmos y aplicaciones que sean conscientes del consumo de energía”.

Añade que esto también implica usar la cantidad adecuada de potencia de cómputo para cada tarea. “No todas las tareas necesitan el modelo de IA más grande posible ni el tiempo de ejecución más rápido”, apunta.

Pero, frente a la acumulación exponencial de datos, puede que también se requiera un replanteamiento más radical, señala Malik. ¿Realmente necesitamos todos los datos que producimos? Cada vez más, parte de la solución, dice, consiste en “ser más intencionales con lo que elegimos conservar”.

Vía: BBC